▒¼╝tAI╚”Ą─StableDiffusionüĒĄĮ┴╦2.0░µ▒Š

ś╦(bi©Īo)║ׯ║ AI painter ╩ųÖC▄ø╝■ ╣┘ŠW(w©Żng)Ż║https://stablediffusionweb.com/

ĪČStable Diffusion2.0(AI painter)ĪĘöUš╣┴╦v1░µ▒Š«ö(d©Īng)ųąĄ─łDŽ±╦č╦„╣”─▄Ż¼į┌╚½ą┬Ą─2.0╔²╝ē░µ▒ŠųąŻ¼┤¾┤¾╠ß╔²┴╦š¹¾wĄ─łD«ŗ╔·│╔┘|(zh©¼)┴┐Ż¼═©▀^įōæ¬(y©®ng)ė├äō(chu©żng)ū„═Ļ│╔║¾Ą─łDŽ±īóĢ■ęį512x512Ž±╦ž║═ 68x768Ž±╦žĄ─ą¦╣¹ų▒Įė│╩¼F(xi©żn)│÷üĒĪŻ

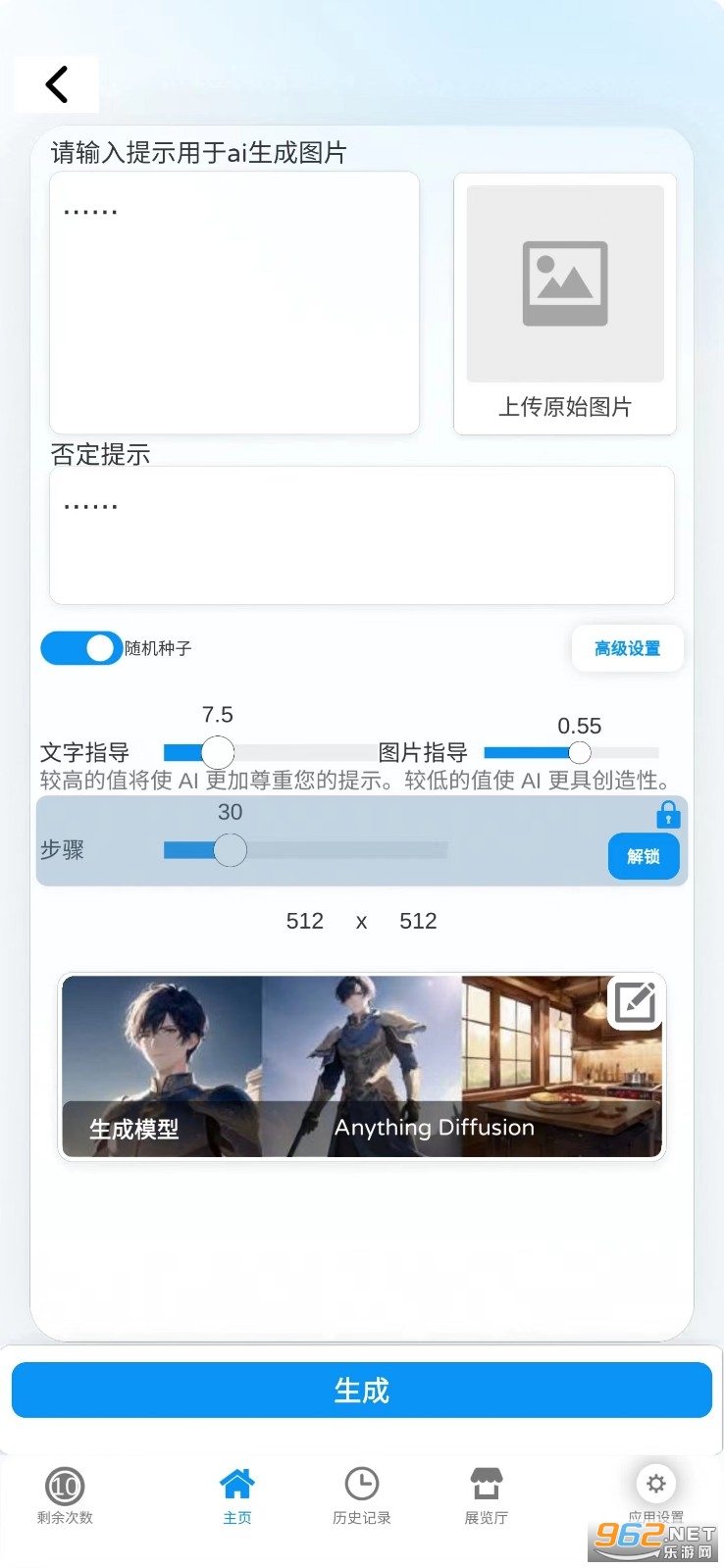

Stable Diffusion2.0APP╩Ūę╗éĆ║▄║├ė├Ą─ųŪ─▄ai└L«ŗĘ■äš(w©┤)▄ø╝■Ż¼▀@┐Ņ▄ø╝■┐╔ęį×ķė├æ¶╠ß╣®žSĖ╗Ą─ai└L«ŗ╣żŠ▀Ż¼┐╔ęįļSĢrūīė├æ¶Ė³╝ė▒ŃĮ▌Ą─▓┘ū„║═╩╣ė├Ż¼ļSĢrØMūŃė├æ¶Ą─└L«ŗąĶŪ¾Ż¼Žļę¬╩╣ė├╩ųÖC└L«ŗĄ─ė├æ¶┐╔ęįį┌▀@éĆŲĮ┼_╔Žę╗ŲüĒ╩╣ė├Ż¼▀Ćėąaiūįäė╔·│╔└L«ŗ╣”─▄Ż¼─Ū├┤ę╗ŲüĒ╩╣ė├░╔ŻĪ

1Īó╩╣ė├ĘŪ│Ż║åå╬Ż¼┐╔ęįų▒Įė╩╣ė├į┌ŠĆćŖŲß;

2Īó┐╔ęįšŲ╬š║▄ČÓ└L«ŗ╝╝Ū╔Ż¼╠ßĖ▀ūį╝║Ą─└L«ŗ╦«ŲĮŻ¼╩╣ė├ĘĮ▒ŃĪŻ

3Īó╩╣ė├įō▄ø╝■ųŲū„łD╝ł┐╔ęį▀_(d©ó)ĄĮ╠ōīŹĮY(ji©”)║ŽĄ─ą¦╣¹Ż¼¾w“×Ė³║├;

4ĪóI└L«ŗĄ─╩╣ė├ĘŪ│ŻŲš▒ķŻ¼žSĖ╗╚½├µĄ─└L«ŗ╣żŠ▀┐╔ęį├Ō┘M╩╣ė├;

5ĪóĮo├┐éĆė├æ¶Ä¦üĒ┴╝║├Ą─▓┘ū„¾w“ׯ¼┴ó╝┤▀M(j©¼n)╚ļŲĮ┼_ķ_╩╝└LłD

1ĪóDepth ╠ß╣®┴╦▓╗═¼äō(chu©żng)ą┬ąįæ¬(y©®ng)ė├Ż¼ļm╚╗╔·│╔Ą─łDŽ±┼cįŁ╩╝łDŽ±ėą║▄┤¾Ą─▓╗═¼Ż¼Ą½╚į╚╗▒Ż│ų┴╦łDŽ±Ą─▀Bž×ąį║═╔ŅČ╚

2ĪóStable Diffusion 2.0 ╔·│╔Ą─╔ŅČ╚ - łDŽ±▒Ż│ųę╗ų┬ąįĪŻ

3ĪóStable Diffusion 2.0 ▀Ćę²╚ļ┴╦ę╗éĆą┬Ą─ text-guided ą▐Å═(f©┤)─Żą═Ż¼ė├æ¶┐╔ęįĘŪ│ŻųŪ─▄Īó┐ņ▀fĄ─ŪąōQłDŽ±▓┐Ęųā╚(n©©i)╚▌Ż¼╚ńŽ┬łDųą▒¬ūėĄ─ūņ░═║═▒Ūūė╩Ū▓╗ūāĄ─Ż¼Ųõ╦¹▓┐Ęų┐╔ęįļSęŌĖ─ūāĪŻ

╔ŅČ╚īW(xu©”)┴Ģ(x©¬)Ą─ė¢(x©┤n)ŠÜŻ¼╩ūŽ╚Š═╩Ūę¬ĮŌøQöĄ(sh©┤)ō■(j©┤)å¢Ņ}ĪŻė╔ė┌stable diffusionĄ─ė¢(x©┤n)ŠÜöĄ(sh©┤)ō■(j©┤)╩Ū ╬─▒Š-łDŽ± Ųź┼õĄ─pairsŻ¼ę“┤╦╬ęéāę¬░┤šš╦³Ą─ę¬Ū¾£╩(zh©│n)éõöĄ(sh©┤)ō■(j©┤)ĪŻ

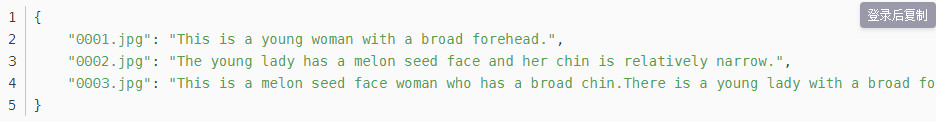

£╩(zh©│n)éõ║├─ŃĄ─╦∙ėąłDŲ¼Ż¼«ö(d©Īng)╚╗ī”ė┌┤¾▓┐Ęų╚╦üĒšfŻ¼ę¬Ą├ĄĮłDŲ¼╚▌ęūŻ¼Ą½╩Ū╩ų└’Ą─łDŲ¼öĄ(sh©┤)ō■(j©┤)Č╝╩Ūø]ėą╬─▒Šś╦(bi©Īo)ūóĄ─Ż¼Ą½╩Ū╬ęéā┐╔ęįė├BLIP╦ŃĘ©üĒūįäė╔·│╔ś╦(bi©Īo)ūóĪŻ

ą¦╣¹ęŖŽ┬łDŻ║

BLIPūįäėĮo├Ņ═▄ĘNūė╔·│╔┴╦ę╗Č╬├Ķ╩÷Ż¼«ö(d©Īng)╚╗╦ŃĘ©Ą─ą¦╣¹║▄ļy▀_(d©ó)ĄĮ═Ļ├└Ż¼Ą½╩ŪūŃē“ė├┴╦ĪŻ╚ń╣¹ėXĄ├▓╗ē“║├Ż¼─Ū═Ļ╚½ę▓┐╔ęįūį╝║ś╦(bi©Īo)ūóĪŻ

īóĄ├ĄĮĄ─textŻ¼┼cłDŲ¼├¹╩╣ė├jsonĖ±╩Į┤µŲüĒŻ║

2ĪóŽ┬▌d┤·┤a─Żą═

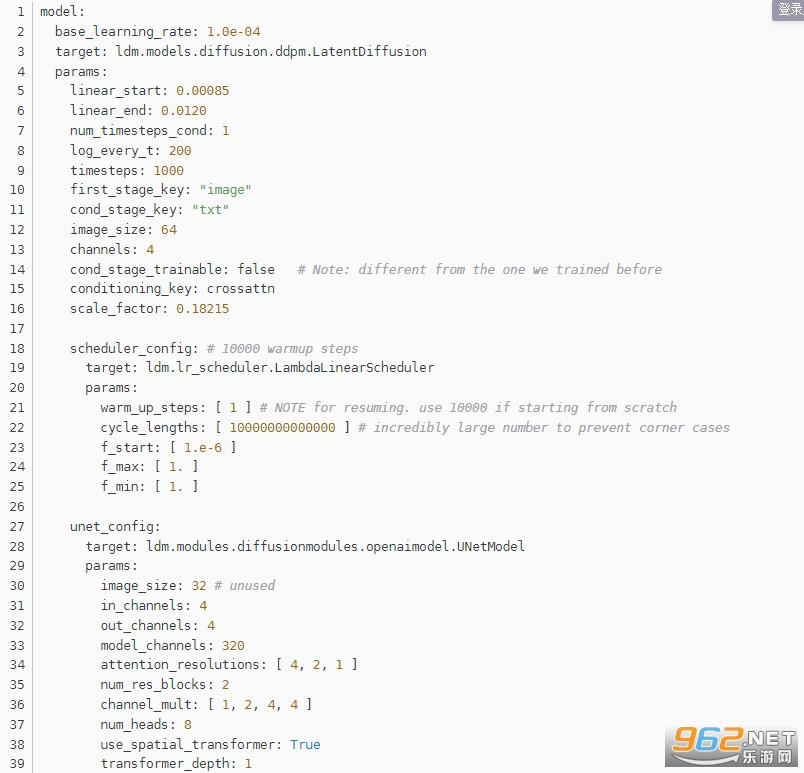

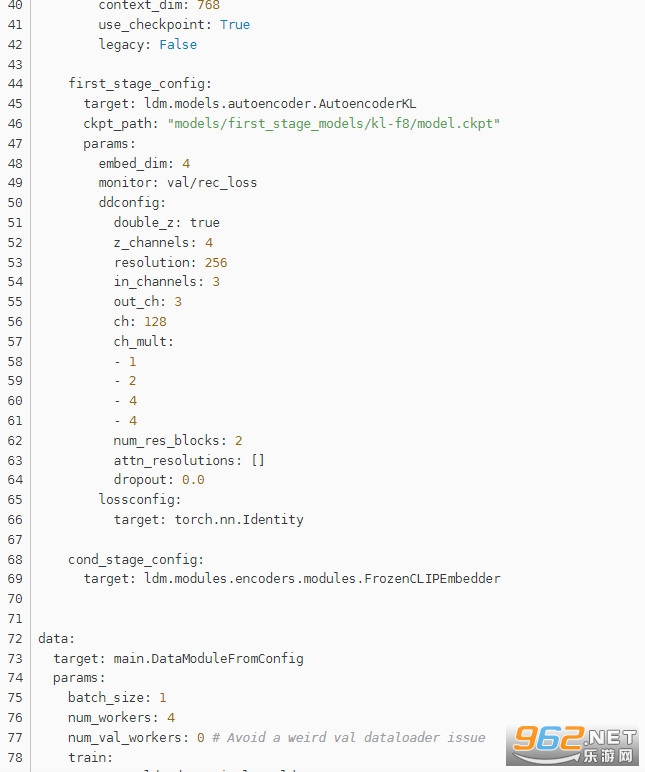

▀@└’╬ęéā╩╣ė├ąĪĖń─¦Ė─Ą─stable diffusion┤·┤aŻ¼Ė³╝ėĘĮ▒ŃfinetuneĪŻ

finetune┤·┤aĄžųĘŻ║https://github.com/justinpinkney/stable-diffusion

░┤šš▀@éĆ┤·┤areadme└’Ą─ę¬Ū¾čb║├Łh(hu©ón)Š│ĪŻ═¼ĢrŽ┬▌d║├stable diffusionŅA(y©┤)ė¢(x©┤n)ŠÜ║├Ą──Żą═ sd-v1-4-full-ema.ckpt Ż¼Ę┼ĄĮ─┐õø└’ĪŻ

─Żą═Ž┬▌dĄžųĘŻ║CompVis/stable-diffusion-v-1-4-original Īż Hugging Face

3Īó┼õų├┼c▀\ąą

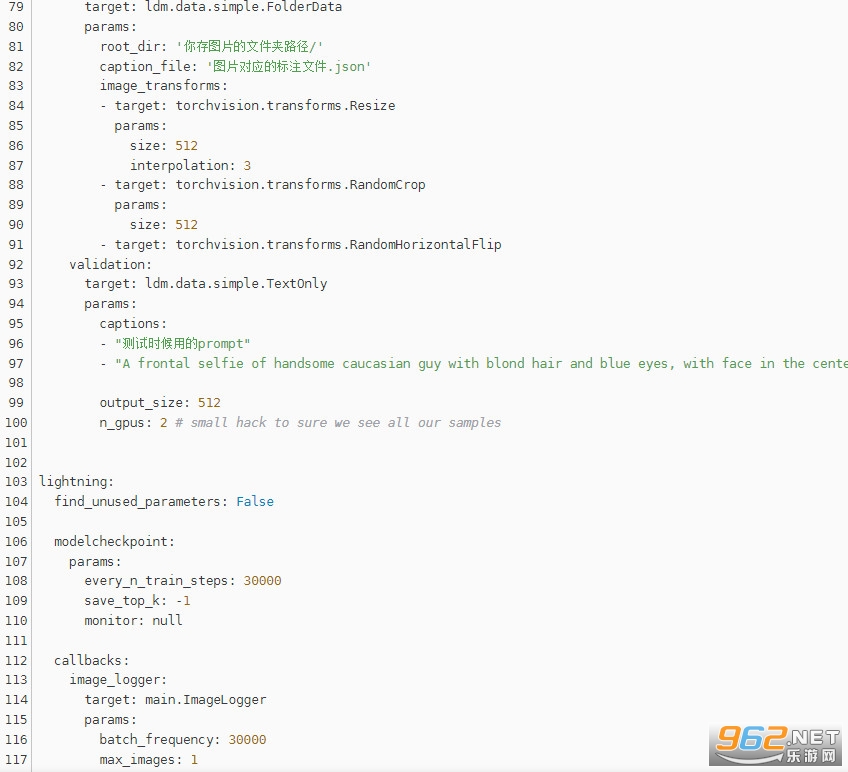

stable diffusion╩╣ė├yaml╬─╝■üĒ┼õų├ė¢(x©┤n)ŠÜŻ¼ė╔ė┌ąĪĖńĮoĄ─yamląĶę¬┼õų├╠žČ©Ą─öĄ(sh©┤)ō■(j©┤)Ė±╩ĮŻ¼╠½┬ķ¤®┴╦Ż¼╬ę▀@▀ģų▒ĮėĮo│÷ę╗éĆĖ³║åå╬ĘĮ▒ŃĄ─ĪŻų╗ąĶꬹ▐Ė─Ę┼łDŲ¼Ą─╬─╝■ŖA┬ĘÅĮŻ¼ęį╝░Ą┌ę╗▓Į╔·│╔Ą─┼õī”öĄ(sh©┤)ō■(j©┤)Ą─json╬─╝■┬ĘÅĮĪŻŠ▀¾wĖ───ā║ų▒Įė┐┤Ž┬├µ:

ūŅ║¾ę╗▓ĮŻ¼▀\ąą├³┴ŅŻ║

python main.py --base yaml╬─╝■┬ĘÅĮ.yaml --gpus 0,1 --scale_lr False --num_nodes 1 --check_val_every_n_epoch 2 --finetune_from ╔Ž├µŽ┬▌dĄ──Żą═┬ĘÅĮ.ckpt

┤¾╣”Ėµ│╔Ż¼Ą╚┤²─Żą═ė¢(x©┤n)ŠÜŠ═ąą┴╦ĪŻąĶę¬ūóęŌĄ─╩ŪŻ¼╬ę▀@▀ģåóė├┴╦ā╔éĆGPUŻ¼▓óŪęstable diffusion╩Ū▒╚▌^│į’@┤µĄ─Ż¼╬ęį┌V100╔Ž▀M(j©¼n)ąąė¢(x©┤n)ŠÜbatchsizeę▓ų╗─▄įO(sh©©)×ķ1ĪŻ

Stable Diffusion2.0APP┐╔ęįĖ∙ō■(j©┤)╬─ūų├Ķ╩÷ų▒Įėäō(chu©żng)ū„│÷╦ćąg(sh©┤)łDŽ±Ż¼┐╔ęįį┌ŠĆ╔Žų▒Įėæ¬(y©®ng)ė├Ż¼ę▓┐╔ęį░▓čbį┌▒ŠĄž╩ųÖC╗“╩ŪļŖ─X┐═æ¶Č╦╔Ž╩╣ė├Ż¼ĘĮ▒Ńäō(chu©żng)ū„š▀▀\ė├Ė„ĘN▓Õ╝■╣żŠ▀╩╣╦ćąg(sh©┤)ą¦╣¹ūŅĮK│╩¼F(xi©żn)Ą─Ė³×ķ¾@ŲGĪŻ

╩ųÖC▄ø╝■Ž┬▌d(╣▓46855éĆ)

╩ųÖC▄ø╝■Ž┬▌d(╣▓46855éĆ)

╩ųÖC▄ø╝■Ż¼╩ŪųĖ─▄į┌╩ųÖC╔ŽĘĮ▒Ńė├æ¶Ą─ę╗ŽĄ┴ą▄ø╝■Ż¼Š▀éõĖ„ĘNĖ„śėĄ─╣”─▄Ż¼ØMūŃė├æ¶Ą─Ė„ĘNąĶŪ¾Ż¼░³└©Ė„ĘN▒Żūo(h©┤)╩ų

▀M(j©¼n)╚ļīŻģ^(q©▒)> │ķ═§š▀ČY║ąŅI(l©½ng)╚Īė└Š├Ųż─w▄ø╝■

2.9M / ųą╬─ / 10.0 / v2.0.0 ūŅą┬░µ

│ķ═§š▀ČY║ąŅI(l©½ng)╚Īė└Š├Ųż─w▄ø╝■

2.9M / ųą╬─ / 10.0 / v2.0.0 ūŅą┬░µ

772323ė╬æ“║ąūėūŅą┬░µ

41.4M / ųą╬─ / 10.0 / v5.2.0

772323ė╬æ“║ąūėūŅą┬░µ

41.4M / ųą╬─ / 10.0 / v5.2.0

iTranslateĘŁūgapp

301.8M / ųą╬─ / 10.0 / v7.0.6 ░▓ū┐░µ

iTranslateĘŁūgapp

301.8M / ųą╬─ / 10.0 / v7.0.6 ░▓ū┐░µ

─¦═µų·╩ųŲš═©░µ

50.6M / ųą╬─ / 10.0 / v2.0.6.0

─¦═µų·╩ųŲš═©░µ

50.6M / ųą╬─ / 10.0 / v2.0.6.0

ą┬┐═app╣┘ĘĮš²░µ

4.2M / ųą╬─ / 10.0 /

ą┬┐═app╣┘ĘĮš²░µ

4.2M / ųą╬─ / 10.0 /

Ųż═¦app

52.1M / ųą╬─ / 10.0 / v1.8.3.121 ūŅą┬░µ

Ųż═¦app

52.1M / ųą╬─ / 10.0 / v1.8.3.121 ūŅą┬░µ

ioŽĄ┴ąė╬æ“(╣▓2239éĆ)

ioŽĄ┴ąė╬æ“(╣▓2239éĆ)

ioė╬æ“Š═╩Ūęį▓┘ū„ęÄ(gu©®)ät║åå╬ĪóČÓ╚╦į┌ŠĆī”┐╣Īó╦└║¾╝┤┐╠Å═(f©┤)╗ŅĄ╚×ķ╠ž³cĄ─ė╬æ“Ż¼╝┤┤¾üyČĘ╗“š▀┤¾ū„æ(zh©żn)ė╬æ“Ż¼▒╚╚ń▒╚

▀M(j©¼n)╚ļīŻģ^(q©▒)> XP3Player─ŻöMŲ„ios├Ō┘M░µ

61.2M / ųą╬─ / 10.0 / v1.3.11 ūŅą┬░µ

XP3Player─ŻöMŲ„ios├Ō┘M░µ

61.2M / ųą╬─ / 10.0 / v1.3.11 ūŅą┬░µ

stable diffusion╩ųÖC░µ░▓ū┐░µ

20.3M / ųą╬─ / 5.0 / v5.3 ūŅą┬░µ

stable diffusion╩ųÖC░µ░▓ū┐░µ

20.3M / ųą╬─ / 5.0 / v5.3 ūŅą┬░µ

Brave Private Browser ios░µ

247M / ČÓć°šZčį[ųą╬─] / 10.0 / v1.67 ūŅą┬░µ

Brave Private Browser ios░µ

247M / ČÓć°šZčį[ųą╬─] / 10.0 / v1.67 ūŅą┬░µ

TopWarriorsć°ļHĘ■

263.8M / ėó╬─ / 10.0 / v1.0.12 ūŅą┬░µ

TopWarriorsć°ļHĘ■

263.8M / ėó╬─ / 10.0 / v1.0.12 ūŅą┬░µ

AudioTool░▓ū┐░µ

2.0M / ėó╬─ / 10.0 / v8.4 ╣┘ĘĮ░µ

AudioTool░▓ū┐░µ

2.0M / ėó╬─ / 10.0 / v8.4 ╣┘ĘĮ░µ

╬³č¬╣Ēąę┤µš▀ios░µ

77.7M / ųą╬─ / 10.0 / v1.2.1

╬³č¬╣Ēąę┤µš▀ios░µ

77.7M / ųą╬─ / 10.0 / v1.2.1

Ė»┼«ė╬æ“(╣▓214éĆ)

Ė»┼«ė╬æ“(╣▓214éĆ)

Ė»┼«ė╬æ“Ż¼ŽļŽļČ╝ėąą®ąĪ║”ą▀─žŻ¼Ė»┼«üĒį┤ė┌╚ššZŻ¼╩Ū×ķŽ▓É█Ąó├└Ą─┼«ąįīŻė├į~ģRŻ¼ķ_╩╝ų╗╩Ū┬■«ŗĄ─┴„ąąŻ¼¼F(xi©żn)į┌ķ_

▀M(j©¼n)╚ļīŻģ^(q©▒)> stable diffusion╩ųÖC░µ░▓ū┐░µ

20.3M / ųą╬─ / 5.0 / v5.3 ūŅą┬░µ

stable diffusion╩ųÖC░µ░▓ū┐░µ

20.3M / ųą╬─ / 5.0 / v5.3 ūŅą┬░µ

roblox╩ųÖCć°ļHĘ■2025░▓ū┐░µ

169.4M / ųą╬─ / 10.0 / v2.666.609 ųą╬─░µ

roblox╩ųÖCć°ļHĘ■2025░▓ū┐░µ

169.4M / ųą╬─ / 10.0 / v2.666.609 ųą╬─░µ

Robloxć°ļHĘ■š²░µ

169.4M / ČÓć°šZčį[ųą╬─] / 10.0 / v2.666.609 ūŅą┬░µ▒Š

Robloxć°ļHĘ■š²░µ

169.4M / ČÓć°šZčį[ųą╬─] / 10.0 / v2.666.609 ūŅą┬░µ▒Š

roblox║¾╩ę┐±▒╝ūŅą┬░µ

169.4M / ČÓć°šZčį[ųą╬─] / 10.0 / v2.666.609 ()

roblox║¾╩ę┐±▒╝ūŅą┬░µ

169.4M / ČÓć°šZčį[ųą╬─] / 10.0 / v2.666.609 ()

kiskiblueė╬æ“

121M / ųą╬─ / 10.0 / v1.73.322381 ░▓ū┐░µ

kiskiblueė╬æ“

121M / ųą╬─ / 10.0 / v1.73.322381 ░▓ū┐░µ

bubble for cubeĒnć°╣┘ĘĮ▄ø╝■

64M / ųą╬─ / 10.0 / v1.1.12 2025ūŅą┬░µ

bubble for cubeĒnć°╣┘ĘĮ▄ø╝■

64M / ųą╬─ / 10.0 / v1.1.12 2025ūŅą┬░µ

Stable Diffusion XL 1.0

Stable Diffusion XL 1.0

Stable Diffusion AIųą╬─(AI painter)

Stable Diffusion AIųą╬─(AI painter)

stable diffusion2.0╩ųÖC░µapp

stable diffusion2.0╩ųÖC░µapp

Stable Diffusion Ai app

Stable Diffusion Ai app

«ŗŽ±╔·│╔AI Stable Diffusion

«ŗŽ±╔·│╔AI Stable Diffusion

AI╣żŠ▀╣▄╝ę

AI╣żŠ▀╣▄╝ę

├└ęūpainter

├└ęūpainter

ÖC«ŗĤAPP(AI painter)

ÖC«ŗĤAPP(AI painter)

Painterųą╬─░µ

Painterųą╬─░µ

Infinite Painter

Infinite Painter

painterūŅą┬░µ▒Š

painterūŅą┬░µ▒Š

Į╗╣▄12123╣┘ĘĮūŅą┬░µ▒Š

Į╗╣▄12123╣┘ĘĮūŅą┬░µ▒Š

ČČ궜O╦┘░µ╣┘ĘĮš²░µ

ČČ궜O╦┘░µ╣┘ĘĮš²░µ

Ė▀Ą┬ĄžłDapp╣┘ĘĮ░µ

Ė▀Ą┬ĄžłDapp╣┘ĘĮ░µ

┐ß╣Ę궜Ęapp╣┘ĘĮūŅą┬░µ▒Š

┐ß╣Ę궜Ęapp╣┘ĘĮūŅą┬░µ▒Š

ąĪ╝tĢ°2025ūŅą┬░µ

ąĪ╝tĢ°2025ūŅą┬░µ

ŠW(w©Żng)ęūįŲ궜Ęapp╣┘ĘĮ░µ

ŠW(w©Żng)ęūįŲ궜Ęapp╣┘ĘĮ░µ

īŻśI(y©©)Ą─ė╬æ“Ž┬▌dĪóŠC║ŽķT涊W(w©Żng)šŠ

Copyright 2009-2016 www.mmd178.cn ░µÖÓ(qu©ón)╦∙ėą

ȧICPéõ17018784╠¢-1

¤ßķTįušō

ūŅą┬įušō

ų¦│ų( 0 ) ╔wśŪ(╗žÅ═(f©┤))

ų¦│ų( 0 ) ╔wśŪ(╗žÅ═(f©┤))